IA

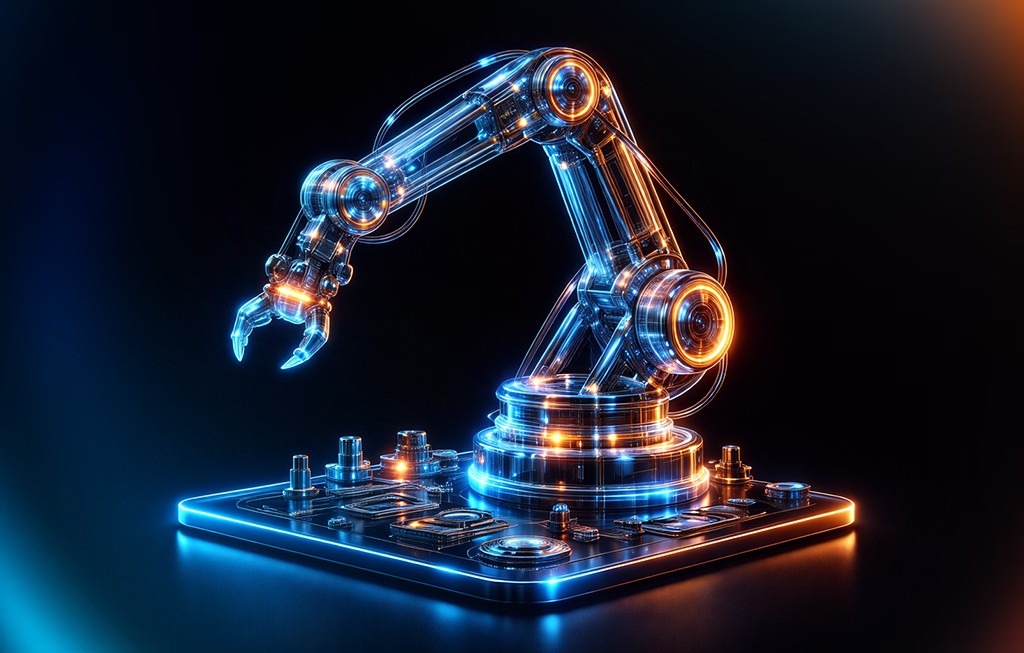

Prédictions incertaines de l'IA robotique : le risque physique en zone partagée

L'intégration de modèles de perception visuelle transforme les lignes de production, mais introduit une vulnérabilité critique : l'incertitude probabiliste. Lorsqu'un système automatisé évolue à proximité immédiate d'un opérateur, une erreur d'interprétation non détectée se traduit instantanément par un danger matériel. Pour sécuriser ces environnements partagés, nous déployons avec TrustalAI une couche de fiabilité qui évalue chaque décision algorithmique en temps réel. Cet article analyse la mécanique de ces défaillances invisibles et détaille les réponses techniques pour garantir la conformité des cellules automatisées.

L'IA robotique au cœur de l'industrie moderne : promesses et défis

L'intégration de l'IA robotique redéfinit les standards de production, exigeant de nouvelles approches pour garantir la sécurité des opérateurs.

L'évolution des robots intelligents et l'usine 4.0

Historiquement, les systèmes industriels reposaient sur des séquences de code rigides et immuables. Les trajectoires spatiales étaient fixes, les cadences d'exécution prédictibles à la milliseconde près, et l'environnement de travail strictement isolé par des barrières physiques. Aujourd'hui, le marché bascule massivement vers des robots intelligents équipés de modèles de perception avancés. Ces machines intègrent la vision 2D/3D, la détection dynamique d'obstacles et la reconnaissance de pièces complexes pour s'adapter à leur environnement. Cette transition technique s'accompagne d'un changement de paradigme fondamental : le système n'exécute plus un programme déterministe, il prend des décisions probabilistes basées sur des inférences statistiques. Ce glissement d'une exécution binaire vers une interprétation continue de l'environnement crée un nouveau type de risque physique, car la machine opère désormais sur des probabilités plutôt que sur des certitudes absolues. C'est cette variabilité inhérente aux algorithmes qui constitue le problème central de la robotique moderne.

Les bénéfices de l'IA pour l'automatisation et la productivité

L'adoption de l'intelligence artificielle robotique apporte des gains quantifiables sur les lignes d'assemblage. Les industriels constatent une flexibilité accrue face à la variabilité géométrique des pièces, des cadences de tri optimisées, et une réduction drastique de la supervision humaine pour les tâches d'inspection répétitives. Ces bénéfices opérationnels sont réels et justifient les investissements des entreprises dans ces nouvelles architectures. Toutefois, ces performances reposent sur une hypothèse technique non vérifiée : la présomption que la perception générée par l'IA robotique est toujours fiable, quelles que soient les conditions lumineuses ou matérielles. C'est précisément cette hypothèse de fiabilité absolue que la réalité du terrain vient remettre en question.

Le défi inhérent de la perception et de la décision autonome

Le défi structurel des réseaux de neurones appliqués à la vision industrielle réside dans leur architecture même : les modèles de perception génèrent des prédictions sans indiquer leur niveau de fiabilité. Un algorithme de détection fournira systématiquement des coordonnées spatiales, même si l'objet analysé est partiellement masqué ou inconnu. C'est pourquoi l'IA industrielle nécessite une couche de fiabilité, comme celle proposée par TrustalAI, pour passer du PoC à la production sécurisée. Sans cette capacité à évaluer la certitude d'une inférence, les entreprises déploient des systèmes aveugles à leurs propres limites, risquant de valider des mouvements physiques sur la base d'analyses erronées.

Prédictions incertaines de l'IA robotique : le risque physique en zone partagée

L'interaction directe entre l'homme et la machine révèle les limites critiques des modèles de perception actuels lorsqu'ils opèrent sans supervision.

Ce que "prédiction incertaine" signifie pour un système robotique

Imaginons un scénario terrain concret : un opérateur et un bras articulé coexistent dans une cellule d'assemblage en zone partagée. Le système perçoit son environnement via son modèle de vision par ordinateur. Que se passe-t-il quand ce modèle produit une prédiction incorrecte sans le signaler ? Le robot exécute son mouvement avec la même vélocité que si l'analyse était parfaite. C'est ce que nous appelons une erreur silencieuse. Une prédiction incertaine en robotique industrielle désigne une inférence produite avec une haute confiance apparente sur une situation hors domaine d'entraînement (OOD). Le modèle ne "sait pas qu'il ne sait pas". Pour illustrer simplement : un capteur de température défaillant continuera de retourner une valeur numérique erronée (par exemple 20°C alors qu'il fait 80°C) sans émettre de signal d'alerte. L'IA de perception souffre du même biais, mais avec une complexité décuplée. Lorsqu'une situation sort de sa distribution d'entraînement initiale, qu'il s'agisse d'un éclairage rasant inédit, d'une pièce usinée différemment ou d'un obstacle inattendu, l'algorithme continue de prédire avec une apparente certitude. C'est l'invisibilité totale de ce risque algorithmique qui le rend si critique pour la sécurité du personnel.

Les 3 configurations terrain où le risque physique émerge

Sans un score de confiance calculé en temps réel par une solution comme TrustalAI, ces situations OOD restent totalement invisibles pour le contrôleur de la machine. Le risque physique émerge principalement dans trois configurations spécifiques :

Zone partagée dynamique : un opérateur pénètre dans l'espace de travail par une trajectoire ou une posture absente du jeu de données d'entraînement. La localisation est incorrecte, entraînant un mouvement du robot vers l'humain sans aucune alerte préalable.

Introduction d'une nouvelle référence : une pièce présente une géométrie OOD. Le système planifie une préhension à un mauvais emplacement avec une haute confiance apparente, risquant de projeter l'objet ou de briser l'outillage.

Dérive des capteurs : l'encrassement progressif d'une lentille optique dégrade la détection de présence humaine. Le réseau de neurones compense silencieusement cette perte de netteté jusqu'au point de rupture, déclenchant une action dangereuse.

Dans ces trois cas, le constat est identique : aucune alerte n'est émise par le système.

Ce que ça coûte avant et après l'incident : l'angle de Laurent et Thomas

Les conséquences d'une erreur silencieuse se mesurent à deux niveaux distincts. Pour Thomas, directeur de production, un incident implique un coût humain inacceptable, doublé d'un arrêt prolongé de la ligne qui impacte directement la rentabilité. L'intégration d'une fiabilité par prédiction réduit de 40 % les incidents de perception en robotique et permet une réduction de 20 à 30 % des arrêts non planifiés grâce à une approche temps réel. Un arrêt préventif contrôlé n'est pas un arrêt de ligne, c'est une décision du système qui évite un incident et génère automatiquement les logs de traçabilité.

Pour Laurent, intégrateur système, l'enjeu est strictement juridique et contractuel. Selon la Directive Machines (2023/1230), l'intégrateur porte la responsabilité pénale et civile de la cellule livrée. Si une ia robotique blesse un opérateur à cause d'une prédiction incertaine, c'est la responsabilité de l'intégrateur qui est engagée. Il doit prouver qu'il a maîtrisé les risques liés aux avancées de l'ia robotique, ce qui devient impossible si le système est incapable d'évaluer ses propres défaillances avant l'impact. Avec TrustalAI, Laurent livre une cellule qui sait quand elle ne sait pas, et il peut le prouver à son client.

La fiabilité par prédiction : une nouvelle couche de sécurité pour l'IA robotique

Face aux limites des modèles probabilistes, l'industrie doit adopter des mécanismes d'évaluation instantanée des décisions algorithmiques.

Le gap entre sécurité fonctionnelle matérielle (ISO 13849) et erreurs silencieuses de l'IA

Les normes industrielles actuelles, telles que l'ISO 13849 et l'IEC 62061, ont été rigoureusement conçues pour encadrer la sécurité fonctionnelle des composants matériels. Elles excellent pour gérer la rupture d'un câble, la défaillance d'un relais ou la perte d'alimentation électrique. Ces normes ne sont pas dépassées, elles ont été conçues pour un problème différent. La fiabilité par prédiction adresse précisément les erreurs OOD et les dérives capteurs que l'ISO 13849 n'a pas été conçue pour couvrir. La réponse technique n'est pas de supprimer l'IA robotique ni de revenir à une programmation déterministe obsolète, mais d'ajouter une couche de fiabilité qui sait quand le modèle ne sait pas. Les deux approches deviennent alors complémentaires dans une architecture de sécurité complète.

Voici une comparaison structurée des deux paradigmes de sécurité :

Caractéristique technique | Sécurité matérielle (ISO 13849) | Fiabilité par prédiction (IA) |

|---|---|---|

Nature du risque couvert | Défaillances physiques et électriques | Erreurs silencieuses et situations OOD |

Comportement du système | Déterministe et reproductible | Probabiliste et variable |

Méthode de détection | Capteurs de diagnostic matériel | Score de confiance algorithmique temps réel |

Temps de réaction cible | < 10 ms (coupure d'urgence) | < 20 ms à 100 ms (avant mouvement) |

Un score de confiance individuel avant chaque mouvement du robot

L'architecture de cette sécurisation repose sur un flux de données précis : Input → Modèle IA → Prédiction + TrustalAI → Score de confiance → Décision du robot adaptée en temps réel. La fiabilité par prédiction mesure, pour chaque prédiction individuelle du modèle de perception robotique, un score de confiance en temps réel, avant que le robot déclenche un mouvement. Si le score est faible, le système peut ralentir, alerter l'opérateur ou bloquer le mouvement avant que le risque physique se matérialise. Notre solution plug-and-play génère ce score en moins de 100 millisecondes (et même sous la barre des 20 ms en architecture edge), respectant ainsi les contraintes de latence de l'industrie. Le système est black-box compatible et s'intègre sans aucun accès aux poids du modèle ni modification de l'algorithme existant.

Trois niveaux de réponse pour une gestion proactive du risque

L'obtention de ce score de confiance permet d'établir des protocoles de sécurité dynamiques et proportionnés. Nous structurons la réponse du contrôleur selon trois niveaux distincts :

Score élevé, mouvement normal : l'ia robotique exécute sa trajectoire à pleine vitesse, garantissant une productivité maximale.

Score faible, réduction de vitesse : le système ralentit préventivement l'action avant qu'elle ne soit exécutée, laissant le temps à l'opérateur de s'écarter.

Score critique, arrêt préventif contrôlé : le système bloque le mouvement avant que le risque physique ne se matérialise et génère automatiquement les logs EU AI Act Art. 12.

Pour un directeur de production, un arrêt préventif contrôlé n'est pas une défaillance ; c'est une décision proactive qui évite un accident grave et maintient l'intégrité de la ligne.

Impact opérationnel et réglementaire : garantir la sécurité et la conformité

L'intégration d'une évaluation continue des modèles d'intelligence artificielle robotique répond simultanément aux exigences de production et aux contraintes légales.

EU AI Act et Directive Machines : les nouvelles exigences pour les intégrateurs

Le déploiement d'un système robotique en zone partagée relève désormais de l'Annexe III de l'EU AI Act et de la nouvelle Directive Machines (2023/1230). Ces textes imposent une traçabilité stricte des décisions algorithmiques et exigent le passage d'une validation statique à une assurance continue. L'Article 9 requiert que les situations OOD et les dérives capteurs soient documentées. L'Article 12 exige que chaque décision de mouvement soit traçable. Sans score de confiance par prédiction, ces exigences sont impossibles à satisfaire.

La fiabilité par prédiction génère automatiquement les logs de traçabilité requis. Chaque décision de mouvement est documentée avec son score de confiance associé, fournissant une preuve irréfutable que le système a évalué le risque avant d'agir. Cette documentation exhaustive protège juridiquement l'intégrateur en cas d'audit ou d'incident.

Les preuves concrètes de l'efficacité de la fiabilité par prédiction

L'impact de cette approche se mesure par des données terrain. Lors du PoC VEDECOM (Fadili et al., 2025), l'intégration de notre solution a permis :

Une réduction de 83 % des faux positifs critiques sans réentraîner le modèle client

Une réduction de 65 % des erreurs de position (passant de 1,44 m à 0,51 m)

Une diminution de 63 % des erreurs d'orientation (de 6,28° à 2,35°)

Ces résultats prouvent qu'il est possible de sécuriser drastiquement les applications de l'ia robotique sans altérer les performances du réseau de neurones d'origine. L'impact opérationnel immédiat se traduit par moins d'arrêts d'urgence, moins d'incidents de perception, et une continuité de production optimisée.

L'avantage concurrentiel d'une robotique IA fiable et traçable

Pour les intégrateurs systèmes, cette double valeur, sécurité opérationnelle et conformité réglementaire, constitue un levier stratégique majeur sur un marché très exigeant. En équipant leurs solutions de TrustalAI, ils répondent simultanément à la pression de l'acheteur final, qui exige une rentabilité sans faille, et à la pression des autorités de contrôle. La cellule robotique peut prouver qu'elle sait quand elle ne sait pas. Cette capacité à documenter la maîtrise du risque transforme une contrainte légale en un véritable avantage concurrentiel.

Conclusion : vers une IA robotique plus sûre et plus responsable

L'avenir de l'ia robotique ne repose pas uniquement sur l'augmentation de la puissance de calcul ou la complexité des modèles de vision, mais sur notre capacité à maîtriser leur incertitude. Les erreurs silencieuses représentent un risque physique inacceptable en zone partagée, engageant la responsabilité directe des intégrateurs face à la Directive Machines et à l'EU AI Act. En ajoutant une couche d'évaluation en temps réel, les industriels transforment une boîte noire probabiliste en un système transparent et sécurisé.

Questions fréquentes sur l'IA robotique et la sécurité des opérateurs

Comment une IA robotique peut-elle mettre un opérateur en danger ?

Une prédiction OOD à haute confiance apparente sur la présence ou la position d'un opérateur entraîne un mouvement incorrect sans alerte. Le modèle de perception génère une prédiction incorrecte (obstacle non détecté, position mal estimée) sans émettre de signal d'erreur. Ce n'est pas un bug logiciel, mais une erreur silencieuse statistiquement possible sur tout modèle déployé. Sans score de confiance individuel, il est impossible de détecter ces cas avant l'incident.

ISO 13849 couvre-t-elle les erreurs de perception des modèles IA ?

Non. L'ISO 13849 et l'IEC 62061 couvrent les défaillances matérielles, pas les erreurs silencieuses OOD des modèles IA de perception. Ces normes ont été conçues pour un problème différent : la sécurité fonctionnelle des composants physiques. La fiabilité par prédiction adresse ce gap spécifique, répondant ainsi aux nouvelles exigences de l'EU AI Act pour les systèmes à haut risque.

Quelle est la responsabilité de l'intégrateur si un robot IA blesse un opérateur ?

Selon la Directive Machines (2023/1230), l'intégrateur porte la responsabilité pénale et civile de la machine livrée, y compris la couche IA. L'EU AI Act Annexe III impose la traçabilité et la documentation des risques. Sans fiabilité par prédiction documentée, l'intégrateur ne peut démontrer les mesures prises. Notre solution génère automatiquement les logs nécessaires à cette démonstration pour chaque mouvement.

Qu'est-ce que la fiabilité par prédiction en IA robotique ?

C'est la capacité d'un système à évaluer, en temps réel (< 20 ms en Edge) et pour chaque décision individuelle, si sa prédiction est suffisamment fiable pour déclencher un mouvement physique. Contrairement au monitoring classique qui mesure la performance globale après coup, elle évalue le risque avant l'action. Notre solution s'intègre en plug-and-play, est black-box compatible, et ne nécessite aucune modification du modèle existant.

Partager

Articles connexes